Introduction

HP ZGX Nano G1n AI Station を購入したので流行りの Local LLM 環境を構築。

How to setup?

1. ollama のインストール

1 | $ curl -fsSL https://ollama.com/install.sh | sh |

次に、ollama が後述の Open WebUI の コンテナ内からアクセスできるよう、待ち受けのアドレスを変更する。

/etc/systemd/system/ollama.service を開き、[Service] セクションの最終行に下記を追加。

1 | + Environment="OLLAMA_HOST=0.0.0.0" |

編集終わったらデーモンを再起動。

1 | $ sudo systemctl daemon-reload |

2. Open WebUI のインストール

すでに ollama がインストールできているので、Open WebUI のみインストール。--restart always でシステム起動時に自動実行されるようになる。--add-host=host.docker.internal:host-gateway でコンテナからホストマシンにアクセスできるようになる。

1 | $ sudo docker run -d -p 3000:8080 \ |

ブラウザで http://<インストール先のip>:3000 にアクセス

はじめる を選択

ログイン情報を入力

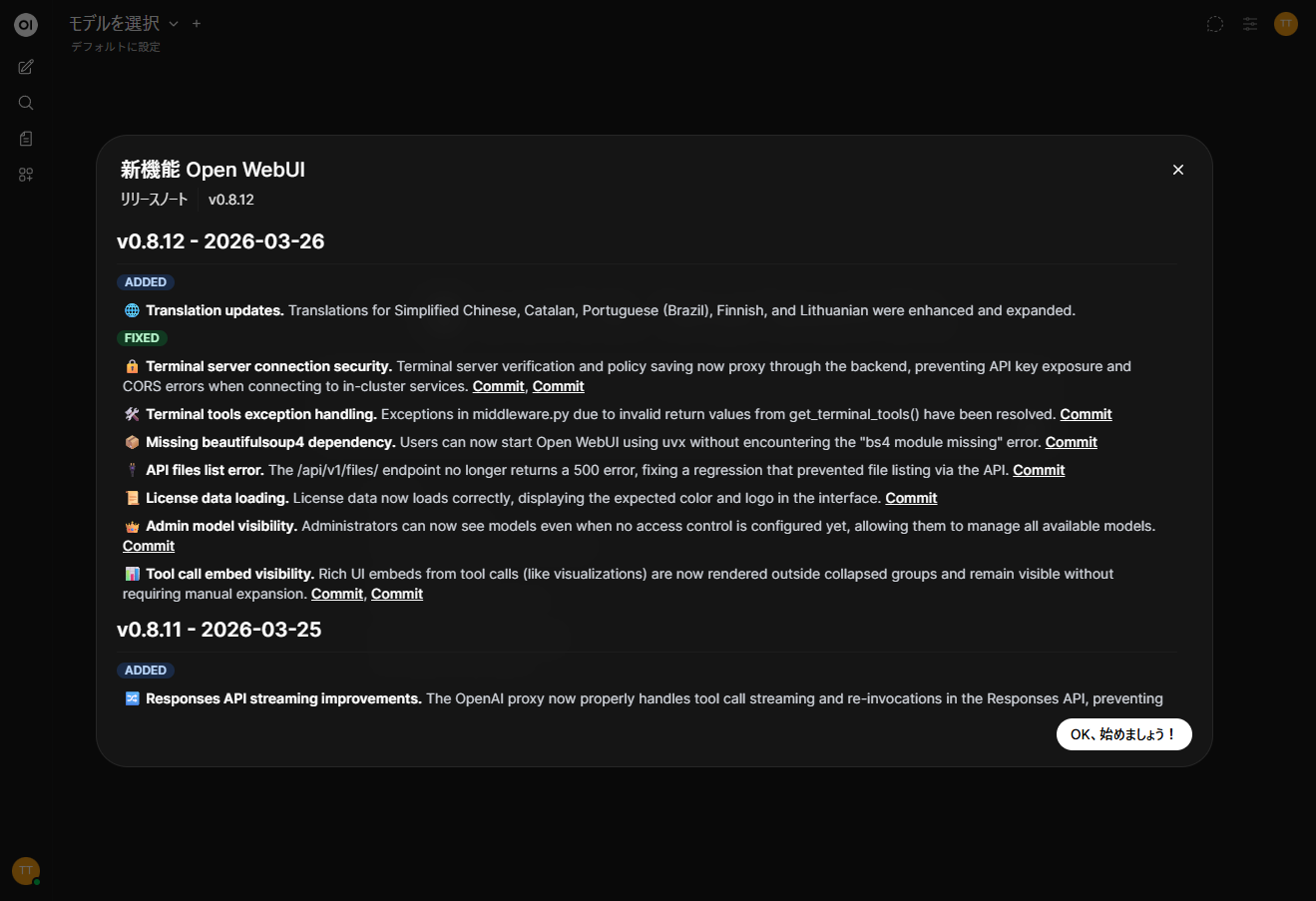

OK、始めましょう! を選択

Open AI の WebUI と似ている見慣れた画面

3. Open WebUI と ollama を連携

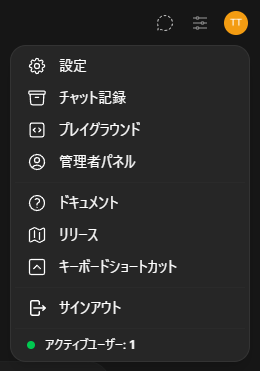

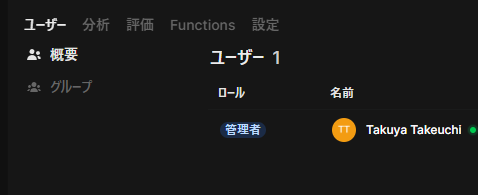

続いて 右上 のアイコンから 管理者パネル を選択

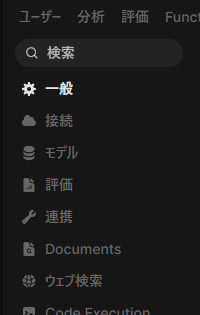

設定 を選択

接続 を選択

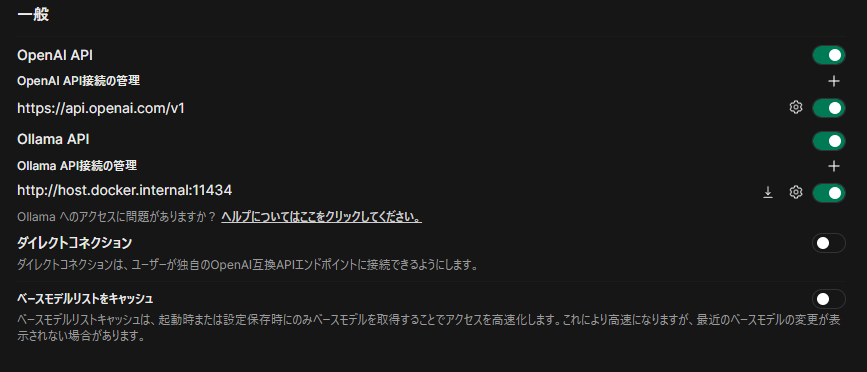

Open API を OFF に変更し、 Ollama API接続の管理 でアドレスが http://host.docker.internal:11434 になっていることを確認。

その右にあるダウンロードアイコンをクリック。

ここでシステム上の Ollama との接続できていないとエラーになるので、その場合は Firewall や docker との接続を確認。

少なくとも netstat -lnpt | grep 11434 で LISTEN が存在しないなら、Ollama は起動していないし、存在していてもアドレスが 127.0.0.1 なら、先述の OLLAMA_HOST の設定が正しく反映されていない。

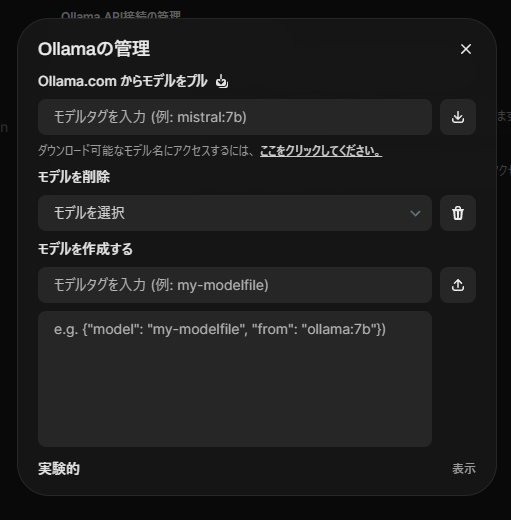

Ollama.com からモデルをプル で好きなモデルを入力し、右側のダウンロードアイコンを押下。

自分は gemma4:26b を指定した。

直後、進捗ダイアログが表示されるので気長に待つ。

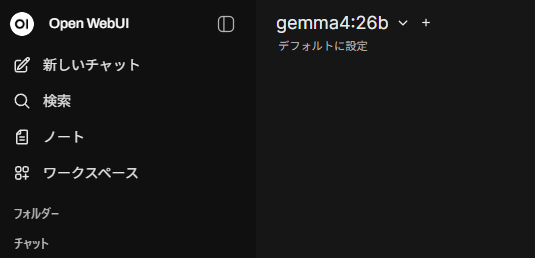

完了したらいつものチャット画面に戻り、左上に先ほど指定したモデルが表示されているのを確認する。

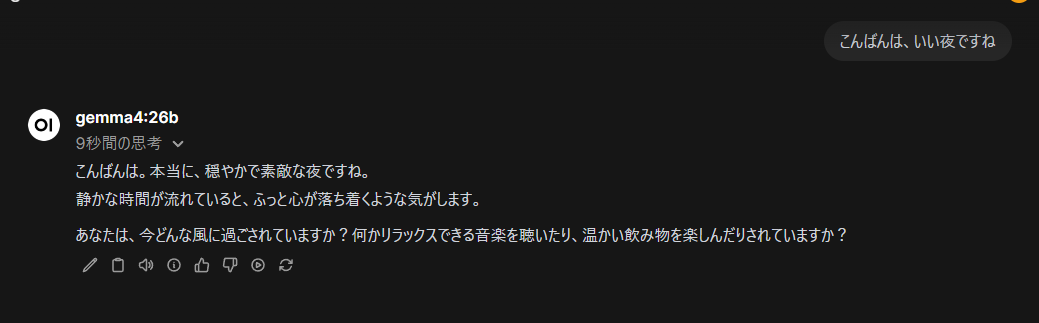

試しに日本語で挨拶し、正しく動作していることを確認。

(一番最初の会話はモデルの初期化や初回推論の影響で遅いため注意)

5. ウェブ検索の有効化

Open WebUI では Open AI のように、モデルが保持していない知識に関して、ウェブから情報を拾ってくるようにする機能のが備わっているので、それらを有効にする。

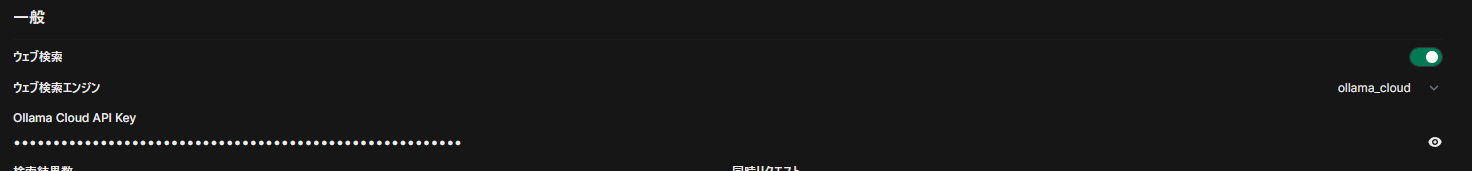

管理者パネル から ウェブ検索 を選択。

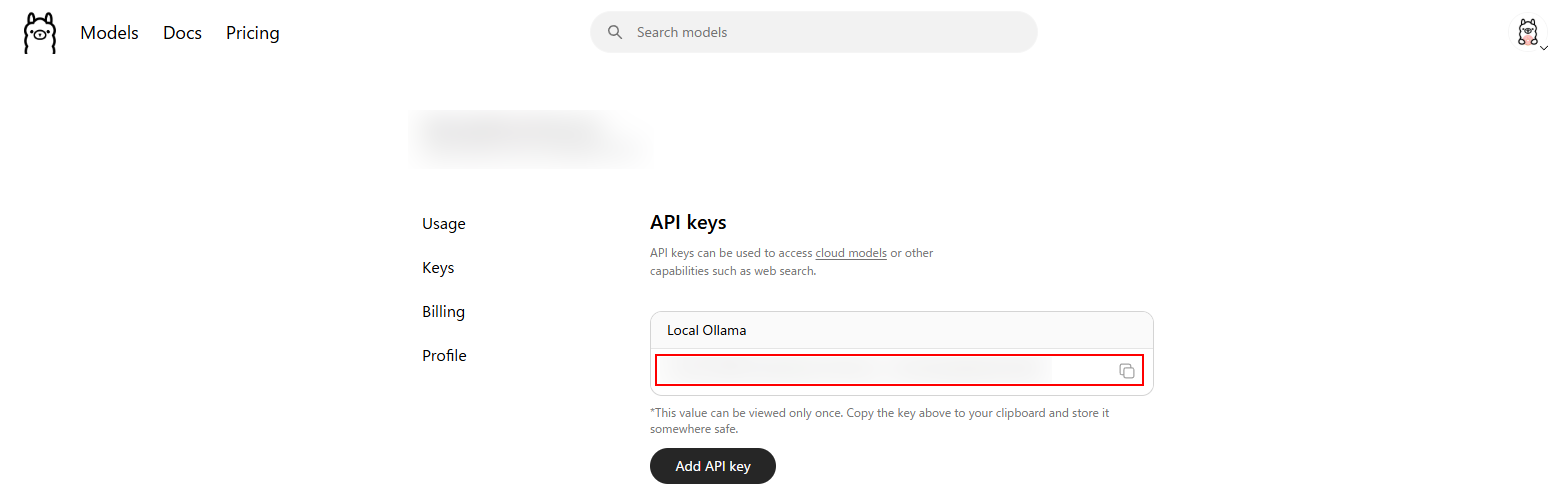

今回は ollama_cloud を使うので、ollama.com にサインアップし、API キーを取得する。

コピーしたキーを Ollama Cloud API Key に張り付けて 保存 を押下。

以上で設定は完了。

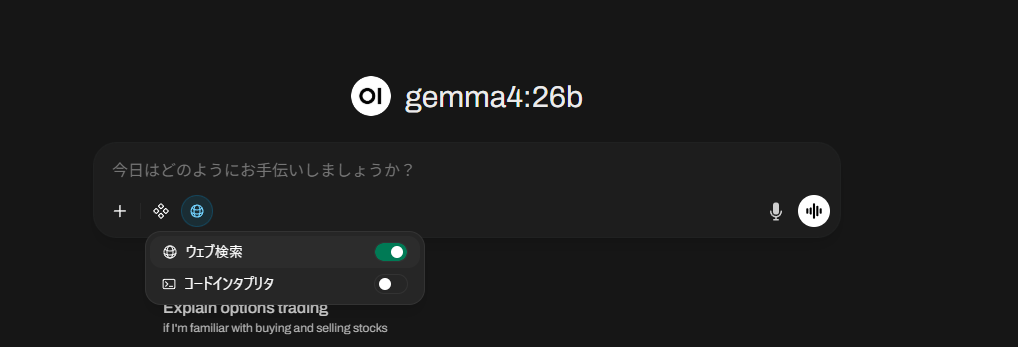

実際に Web 検索を使うには、質問する際に Web 検索を有効にする必要がある。

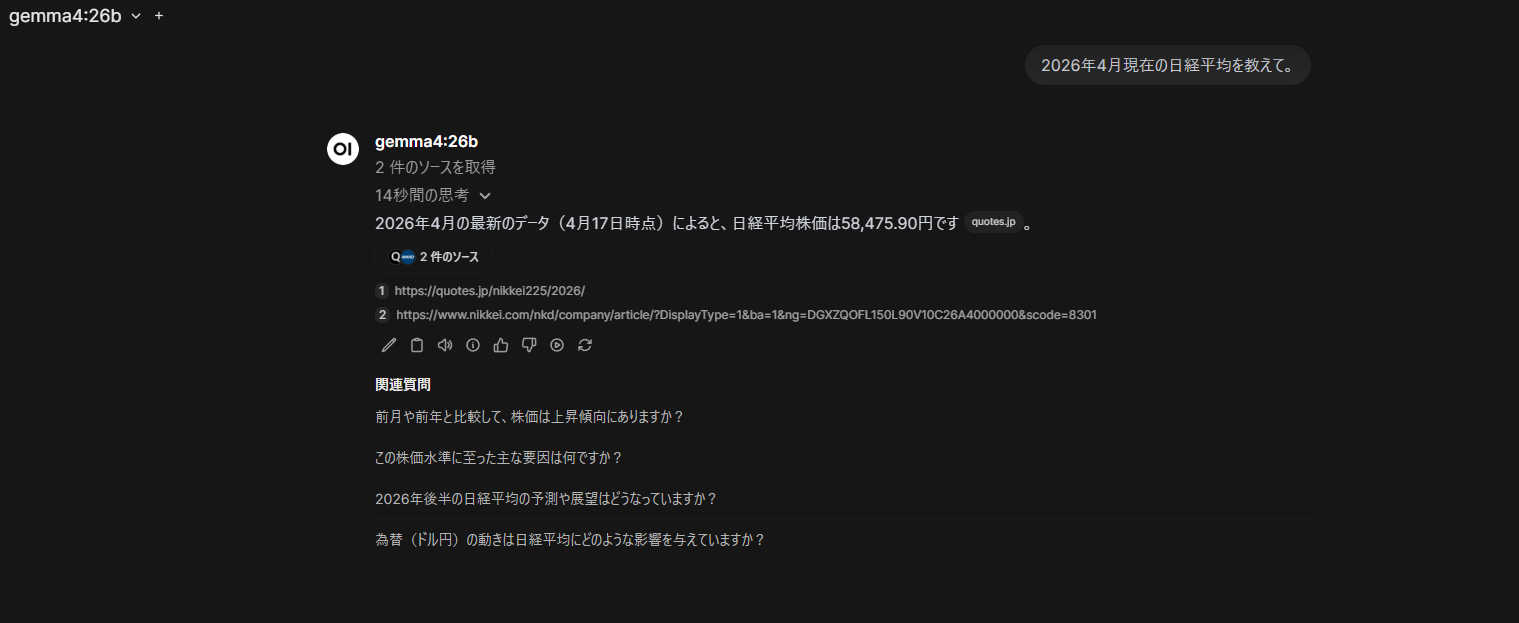

そして質問を実行すると、検索にしたソースも提示した回答を生成してくれる。